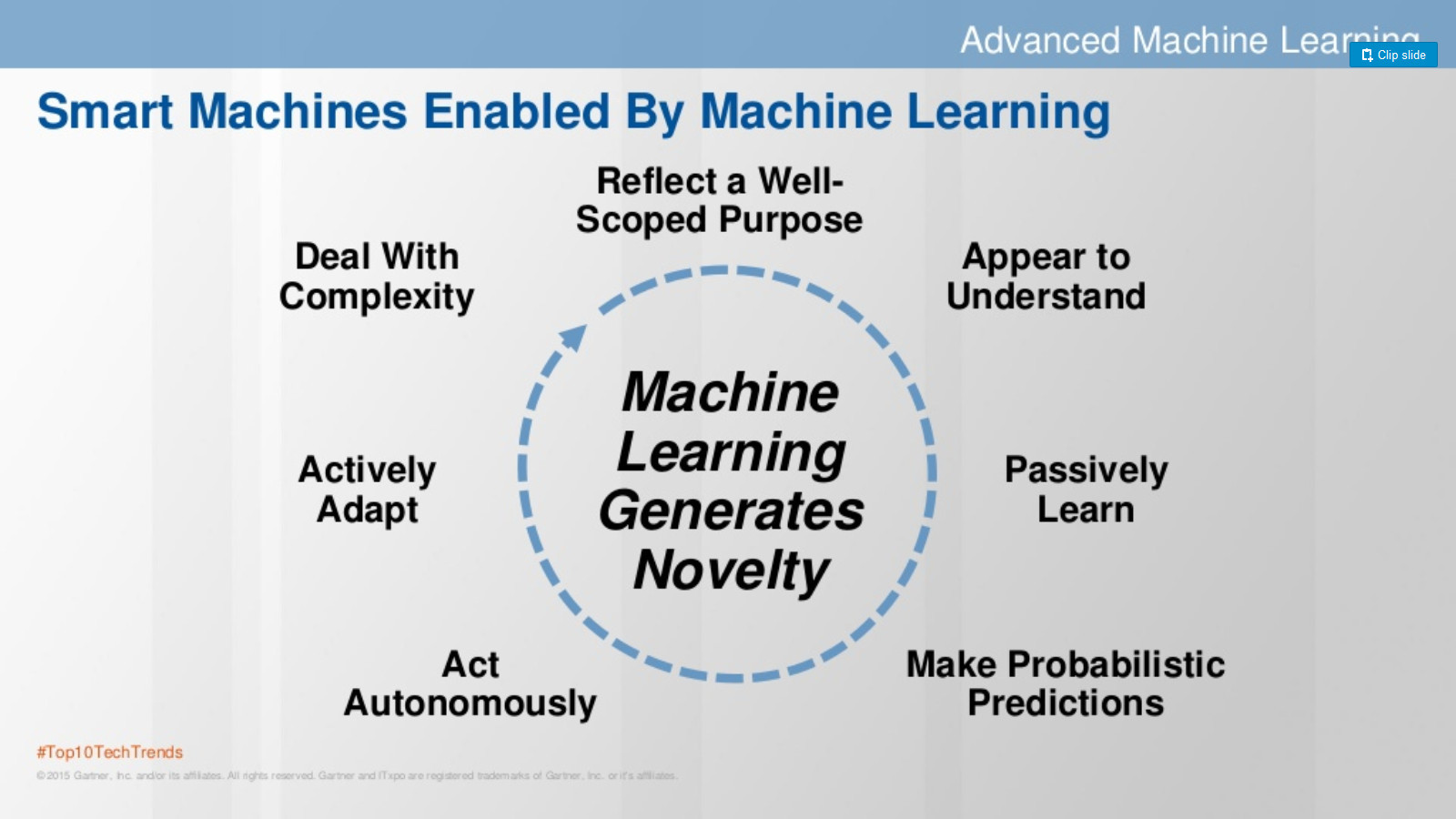

このトピックに対処すればするほど、特にロボット、スマートマシンなどの時代の到来などの進行中の予測に照らして、より興味深いものになります。 そして、そのようなマシンが作成されるのは驚くことではありません。 進化は、人間が自分自身を拡張することを学び、マンマシンの共生を生み出すことを示しています。 フェンスを歩いていると、爪が飛び出します。 ああ、ハンマーなしでハンマーを打つのはどれほど難しいか。 そしてハンマーで-すぐそこに。 したがって、脳活動に同じ「ヘルパー」が現れることは驚くことではありません。

トピックを研究する過程で、私は機械学習が私たちの心がどのように機能するかを説明しているように見えると考えるのをやめませんでした。 以下に、機械学習の学習中に人について学んだ教訓をリストします。 私は正しいふりをしません。これがすべて明白な場合は謝罪します。素材が楽しい場合、または「理解できない」ものへの信仰によって(再び)始める反例がある場合、私は喜んでいます。 ところで、HSEには、機械学習を使用して脳の仕組みを理解するコースがあります。

1)最も単純なアルゴリズムのアンサンブルは、想像を絶するデータヒープを高い精度で理解できます。 この点に関して、私は最近亡くなったミンスキーを思い出します。ミンスキーは、一緒に私たちの心を形成する愚かなエージェントについての本全体を書きました。 心のこの解釈は、私たちの心であるすべての魔法は、経験によって訓練された単純なモデルの集まりにすぎないと想像することを可能にします。

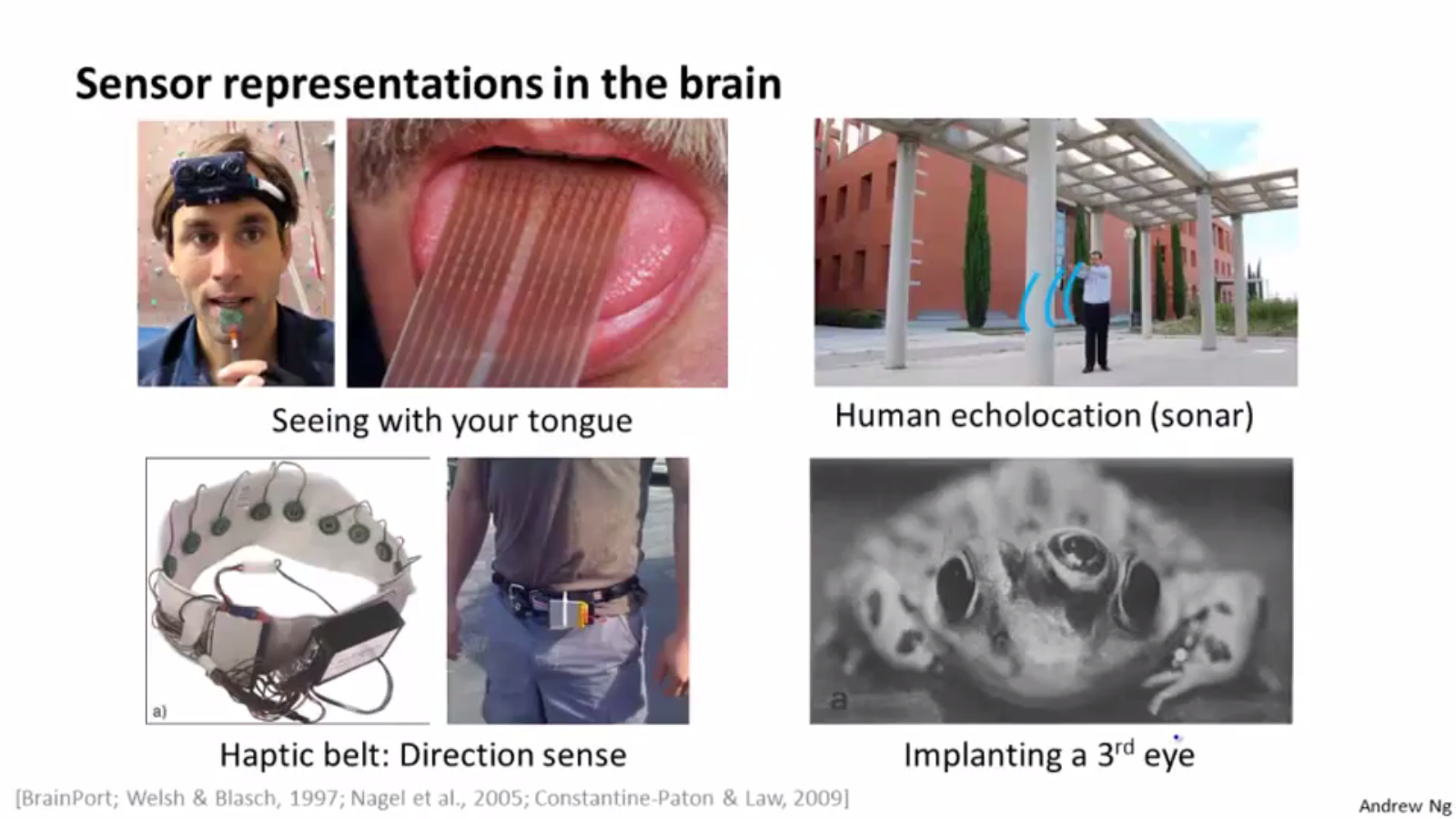

2)学習経験の観点から、Andrew NGのお気に入りのスライドの1つを思い出します。

その上で、アンドリューは、たとえば舌で見るために失われた機能を脳が他の部門(まだモデルがない)に教えることができるという事実に焦点を当てています。

3)脳の研究者は、人が非常に小さいときに心が置かれることを知っています。 幻想的な変化が起こっています-音から、人は会話を理解し始め、親/見知らぬ人を認識します。 子供たちはまだコンピューターを破っていますが、これは私たちの心が巨大な生物学的ニューラルネットワーク( 860億ニューロン )によって膨大な情報(たとえば3年間の連続写真)で訓練された非常に良いモデルであるように見えることを示しています。

4)一部のモデルは何らかの方法で説明および変更できるようです-「サンドボックス」(「これがなぜそうなのか」、精神分析などの修正方法など)などの領域があり、一部は無意識の「生産」に入ります(習慣と自動アクション:長年の練習の後の車の運転、呼吸、運動など)。 生産がどのように機能するかの例は、古典的なClive Wearingケースです。 人間は記憶する能力を完全に失いました。 「特定のビデオ録画を連続した日に何度も見たことがありますが、彼はビデオを見たり、コンテンツを知ったことの記憶がありませんでしたが、どのように学習したかを覚えずにコンテンツの特定の部分を予測することができました。」 。 過去に訓練されたモデルはメモリ内にあり、次の視聴の予測を提供します。 モデル-記憶に残り、過去に関するデータ-いいえ。

5)おそらく、多くの人は自分のモデルを作成または更新し、「生産」にあるもの、もはや関係のない履歴データに基づいて作成された既製のモデルで生活するのが面倒です。 したがって、人を変えることは非常に困難です:もちろん、彼は(無意識のうちに)量が少ない新しい信頼できるデータよりも膨大な量の過去の情報で訓練されたモデルを信頼します。

6)動物は「生産中」のモデルにのみ住んでいます-モデルを分析的に分析することはできず、再訓練せずにモデルを変更することはできません( ceteris paribus )。 彼らは、電球から、食物なしで唾液を流します。

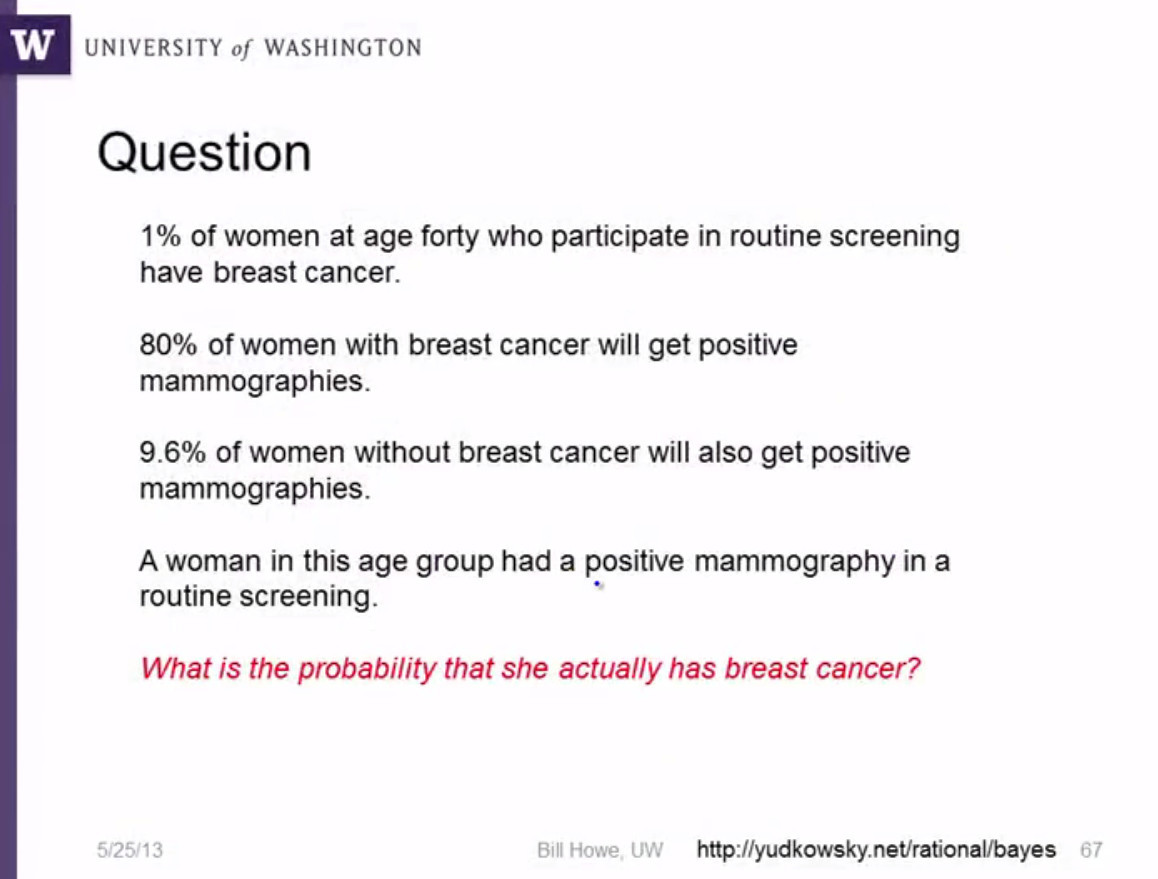

7)特に慎重に考えていない場合、脳はしばしば機械よりも劣っています(分析)。 たとえば、ビルハウコースのジャンルの古典、実践的予測分析:モデルと方法:

15%(!)医師の正解(回答:7.8%)。

8)直感は説明できない複雑なモデルです。 直感-常にデータとモデルに基づいています。 Malcolm Gladwellの本「Blink」からの最良の例は、「ラケットがボールと接触する前にプレーヤーがいつダブルフォールトするかを知っているテニスコーチ」です。 つまり 長年の観察で訓練された彼のモデルは、ボールがフィールドにヒットするかどうかの非常に正確な予測を与え、ストライキの前のデータのみを持ちます。

9)原則として、次の一般化を行うことができます。「人は、この分野で訓練されたアルゴリズムを構築したのと同じくらい、ある分野で賢い」。これには、原則として、多くの観察が必要です。 同じGladwellは、約10,000時間の練習でデータが必要であると言います。

10)多くの経験があっても、なぜ賢くなれない人がいるのですか? これは、愚か者が定義される頻度であることに注意してください。「同じ状況(同じデータ)で同じ間違いをする人」。おそらく、モデルの複雑さはすべての人で異なり、モデルを訓練する能力も異なります。

11)モデルのトレーニングには、正と負の例が必要です。 同じタイプの例を使ってアルゴリズムや人に教えることはできません。 人は常にheられたり繰り返されたりする場合、すべてが大丈夫であることを知りません。

12)機械学習と人間学習は、100%の確率で予測しません。 エラーの25%は、4つのうち1つでミスです。 このようなエラーを伴う理想的なアルゴリズムがしばしば誤っていることに驚かないでください(例:通貨レート予測、今年のGDP、 Dota2ゲームなど)。非常にスマートなアルゴリズムが非常に頻繁に間違っている可能性があることに驚かないでください。 ちなみに、多数の予測の平均が役立ちます。1回の観測よりも、予測によって判断する方が適切です。

13)愛、音楽、芸術など 称賛の対象からのデータを「成功」の確率、「好きな」接続の活性化などに変換する、訓練されたモデルと明確に関連しています(正しい意味で理解してください)。

14)機械学習は、予測エラーを最小化することで構築されます。これは、スマートな人(マインド)の定義そのものに対応します。

15)人と機械の両方でアルゴリズムが2回目に機能する理由を説明する機能。 この点で、 仏は想起されます:

「ある日、マルルキャプッタは午後の瞑想から立ち上がって仏に行き、彼に挨拶し、片側に座って言った。

サー、私が一人で瞑想していたとき、この考えが思い浮かびました。これらの問題は説明されず、脇に置かれ、祝福された者によって拒否されました。 つまり、(1)は永遠の宇宙である... '

仏の答えからの抜粋:

'...Māluṅkyaputta、男が毒矢で負傷し、彼の友人や親relativeが彼を外科医のところに連れて行ったとしよう。 その男が次のように言うべきだとしよう。 彼が(戦士カーストの)クシャトリヤ、(聖職者カーストの)ブラフマーニャ、(貿易と農業カーストの)バイシャ、または(低カーストの)シュードラのいずれであるか。 彼の名前と家族は何ですか? 彼が背が高い、背が低い、または中程度の身長であるかどうか; 彼の顔色が黒、茶色、金色のいずれであるか:どの村、町、または都市から来たか。 私が撃たれた弓の種類を知るまで、私はこの矢を取り出させません。 使用される弦の種類; 矢印のタイプ。 どんな種類の羽が矢に使用され、どのような材料で矢の先が作られたのか。」マールーキャプッタ、その男はこれらのことを知らずに死ぬだろう...

...したがって、Māluṅkyaputta、私が説明したように説明したことと説明していないと説明していないことを念頭に置いてください。 私が説明していないことは何ですか? 宇宙が永遠であるかどうかなど、私は説明していません。 なぜ、マールキャプッタ、私はそれらを説明しなかったのですか? それは役に立たないので、それは霊的な聖なる生活と根本的に関係しておらず、嫌悪、分離、停止、静けさ、深い浸透、完全な実現、ニルヴァーナを助長しません。 だから私はそれらについてあなたに話していないのです。」