たとえば、物理学者のスティーブン・ホーキングとして話すことができない麻痺した人は、会話を行うために脳インプラントを使用できますか?

今日、これは米国大学の絶えず進化する研究の主な目標であり、5年以上にわたり、人間の頭蓋骨の下に置かれた記録装置が人間の会話に関連する脳活動を検出できることを証明しています。

結果は暫定的なものですが、カリフォルニア大学サンフランシスコ校の脳神経外科医であるエドワード・チャンは、音声シンセサイザーを使用して脳信号を直接音声に変換できるワイヤレスニューロコンピューターインターフェースに取り組んでいると言います。

音声補綴物を作成する作業は、実験の成功に基づいています。ボランティアとして行動する麻痺した人々は、脳インプラントを使用して、思考を犠牲にしてロボットの手足を操作しました(「 思考実験 」を参照)。 この技術は実行可能であり、科学者が大脳皮質の運動領域内のニューロンの興奮をおおよそ解釈し、それらを腕または脚の動きと比較できるという事実により機能します。

現在、チャンのチームは、話す能力について同じことを繰り返しています。 このタスクははるかに複雑です。一部には、人間の言語は全体的に彼に固有のものであり、この技術は、たとえば動物で簡単にテストできないためです。

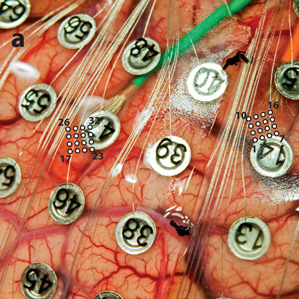

彼の大学で、チャンは、てんかん患者に対して行う脳手術と併せて音声実験を行っています。 患者の頭蓋骨の下に置かれた電極のプレートは、脳の表面からの電気的活動を記録します。 患者は、医師が発作の正確な原因を見つけることができるように、「皮質脳波記録装置」として知られるデバイスを数日間着用します。

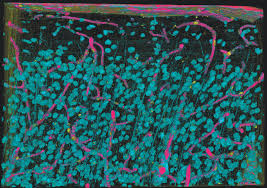

Changは、患者が話すことができるように、患者の脳の活動を研究しています。 ネイチャー誌の昨年の記事で、彼と彼の同僚は、電極アレイを使用して、患者が「音」のような単純な単語を発音したときに、腹側感覚運動皮質と呼ばれる脳の領域の電気活動のモデルを表示する方法を説明しましたbah”(“ナンセンス”)、“ goo”(“スライム”)など。

その考えは、大脳皮質の運動野の電気的活動を記録することです。大脳皮質は、人が話しているときに唇、舌、声帯を動かします。 数学的計算によると、Changチームはこれらのデータから「多くの主要な音声機能」を区別できることを示しました。

側方(筋萎縮性側索)硬化症(ALS)のような病気の最悪の結果の1つは、麻痺の広がり方であり、人々は動く能力だけでなく話す能力も失います。 一部のALS患者は、コミュニケーション能力を維持できるデバイスを使用しています。 ホーキングの場合、彼はソフトウェアを使用して、音節で非常にゆっくりと単語を発音し、頬の筋肉を収縮させます。 他の患者は、コンピュータマウスを制御するためにアイトラッキングデバイス(「iトラッカー」)を使用します。

ニューロコンピューターインターフェースを使用してほぼ話し言葉を実現するというアイデアは以前にも提案されていました。1980年以来、「ロックインインサイド」症候群(覚醒king睡)の人の脳内を直接記録するために単一の電極を使用する技術をテストしている会社です。 2009年に、同社は、移動して話すことができない25歳の麻痺した人のスピーチをデコードする作業について説明しました。

ノースウェスタン大学のマーク・スルツキーによって今年発表された別の研究-彼は、患者が英語の39の音素すべて(音声を構成する子音と母音)を含む声を出して読んだときに、大脳皮質の運動野の信号を解読しようとしました。 チームは、36%の平均精度で音素を特定しました。 この研究では、チャンが使用したのと同じタイプの表面電極を使用しました。

Slutskyは、これまでのところこの精度は非常に低いように見えるかもしれないと言っていますが、限られた時間で話される単語の比較的小さな選択で達成されています。 「将来、はるかに優れたデコード結果を期待しています」と彼は言います。 音声認識システムは、人々が言いたいことを理解するのにも役立ちます、と科学者は言います。

Telebreezeチームが作成した記事

FacebookおよびTwitterページ