だから、私は開発者に言葉を渡します:

数年前、INCOSチームは、非接触制御の分野でプロジェクトを実装しようと考えました。

最初は特定のデバイスに関するものではありませんでしたが、徐々に何かをしたいと思い、最終的にはINCOSシステムが作成されました。 体の動きで画面上のオブジェクトを直接制御できる今日存在するデバイスは、多くの場合、普遍的ではありません。 USBポート経由など、どのデバイスにも直接接続できません。 実際、この前提は私たちにとって創造的な原動力となりました。 他のデバイスとは異なり、当社のシステムは、たとえばスマートテレビをサポートするテレビに接続できます。

この場合、INCOSは非表示デバイスとして定義されます。 実際、システムをコンピューターとテレビだけでなく、USB、Wi-Fi、イーサネット、Bluetoothポートを備え、INCOSをマウスとキーボードとして認識できる他のデバイスにも接続できます。 INCOSのもう1つの利点は、システムが使用可能なプログラムのセットに限定されないことです。 たとえば、2000年以前にリリースされたゲームを含め、あらゆるゲームの制御に使用できます(私はゲーマーではありませんが、時々Starcraftをプレイするのが好きです)。 現在、INCOSオプションは、同時に複数のデバイスに接続するために開発されています。

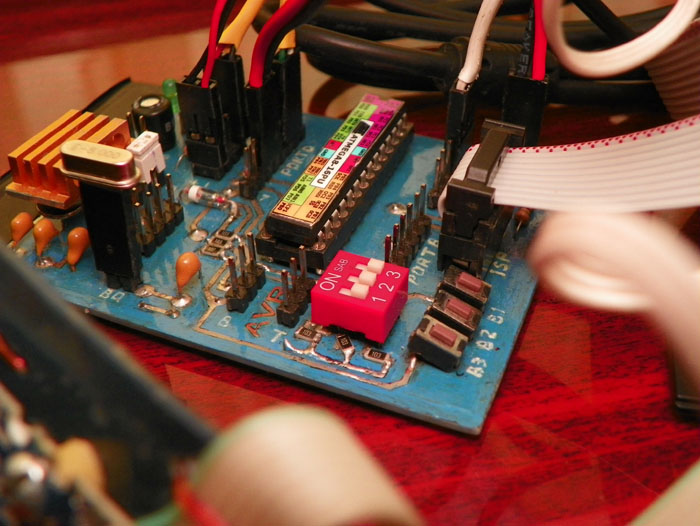

この目的のために、プログラム可能なUSBスイッチを使用することになっています。 したがって、各デバイスは異なる時点で利用可能になります。 INCOSは、テレビのリモコンを使用せずにチャンネルを切り替える「スマートリモコン」機能を提供します。 リモコンのさまざまなボタンにジェスチャーと音声コマンドを割り当てることができます(テレビのリモコンとリモコンのキーセット用の内蔵赤外線レシーバーでINCOSシステムをトレーニングした後)。 kinectなどのさまざまな種類の非接触制御システムは、通常、いわゆるtofカメラに基づいています。 赤外線を使用して、いわゆる深度マップを作成します。 しかし、さまざまな種類のtofカメラを分析し、その価格帯(そして私たちにとって最も適したコピーのコストは数百および数千ユーロと見積もられていました)は、よりシンプルで、安価で、怒りの解決策になりました:ステレオペア。

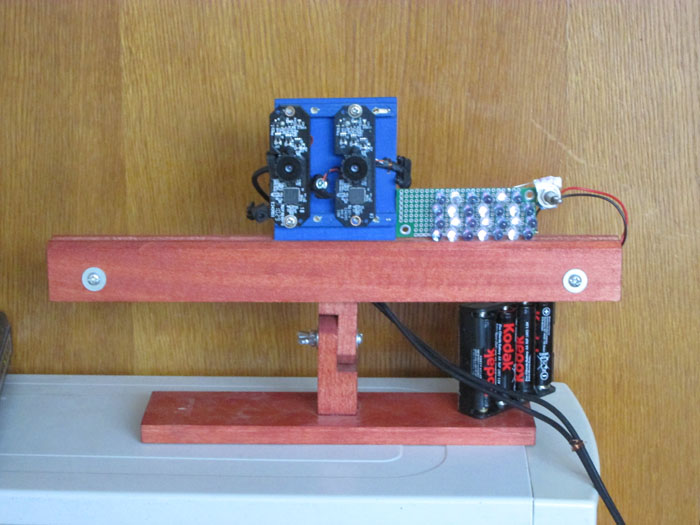

はい、もちろん欠点もあります。 たとえば、ステレオペアに基づいたデバイスは、暗闇よりも明かりの方がうまく機能します(通常、赤外線グリッドを構築するデバイスは逆です)。 ただし、適切なアプローチを使用すると、多くの問題を回避できます(特に、カメラの追加の赤外線照明を使用して前述の問題を解決しました)。

以前は、Raspberryボードはデバイスのベースと見なされていました。 ただし、パフォーマンス上の理由から、別のプラットフォームを選択することにしました(ただし、Raspberryに接続する機能はまだ残っています)

現在、システムの中核はCubie mini-PC(AllWinner A10プロセッサーに基づく)ですが、新しいCubieboardモデルのリリースに関連して、プロセッサーをより強力なものに置き換えることも検討されています。

追加の赤外線照明を備えたテストベンチ

現時点での画像の解像度は320x240ピクセルおよび640x480(これはカメラの周波数とそれに応じた処理速度によるものです)、fpsの数は60以上ですが、この解像度を上げるための作業が進行中です。 デバイスが機能する最大距離は3.5〜4メートルで、最小距離は20〜30センチメートルですが、調整できます。 カメラの視野角(特別な広角レンズを使用)は約800です。

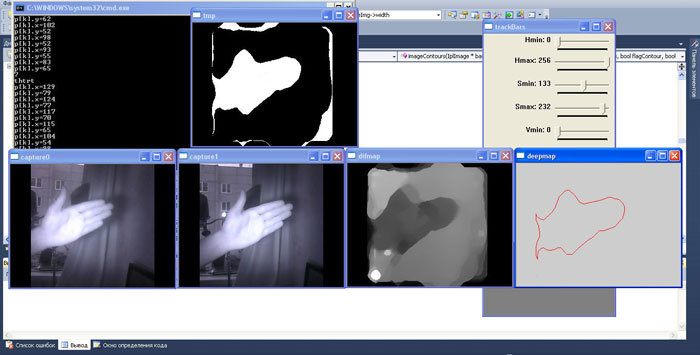

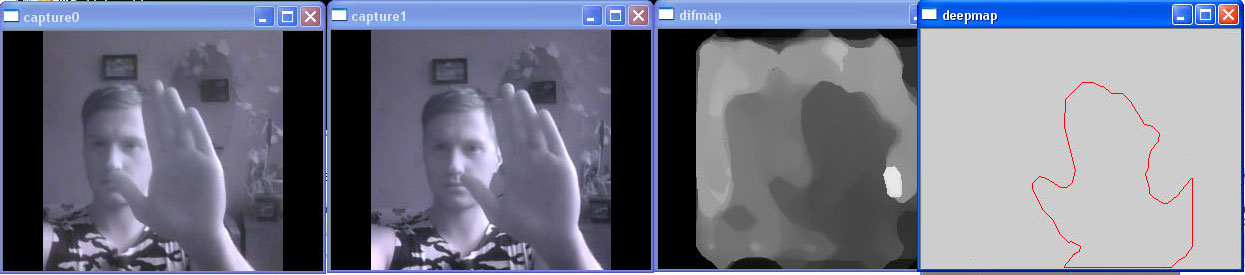

INCOSのソフトウェアコンポーネントを実装するために、OpenCVライブラリを使用し、結果の輪郭のスケルトン化-CGALを使用することが決定されました。 これらのライブラリは両方とも、オープンソースライセンスの下で配布されます。 カメラから受信した2つの画像は、左右の画像のピクセル間の絶対差の移動和を使用するアルゴリズム(Kurt Konoligeアルゴリズム)を使用して処理されます。 したがって、深度マップが構築されます。 次に、特別に設計されたソフトウェアフィルターを使用して、結果の画像からノイズを除去します。

左のカメラからの画像、右からの画像、およびテストベンチの深度マップ。

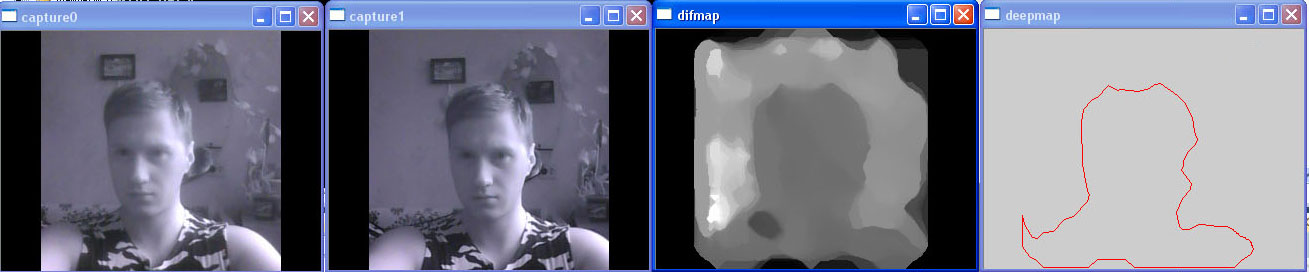

カメラから適切な距離にある(および人体が背景要素よりもカメラに近い)領域を強調表示するために、開発のこの段階でしきい値変換が使用されます。 エッジを強調表示し、人体の輪郭を認識するために、モーメントに基づく輪郭分析が使用されます。 次に、CGALライブラリのメソッドを使用して、モデルのスケルトンが構築されます。 このデバイスを作成する主な目的は、手の制御だけでなく、身体全体の制御でした。したがって、手の骨格では、親指と他の指だけが実際に単一の全体として考慮されます。 次に、ブランチの幾何学的特性が分析され、クラスに分割されます。適切な分類器と機械学習法(特にサポートベクトル法)を使用して、特性点を含むブランチを含みません。 特徴点を決定した後、それらは追跡されます。 ジェスチャ認識の場合、フレームのシーケンスが分析され、ジェスチャ認識は現在、最近傍法を使用して実行されます

画像では、赤外線照明で照らされた手、2値化された画像(上記)、および手の輪郭(スケルトンと特徴点が無効になっています)を見ることができます

スケルトンと機能ポイントの表示が有効

上半身の輪郭認識

図では、手は体よりも近い

ご存知のように、現時点では、このタスクを100%実行する音声認識システムはありません。 もちろん、私たちのシステムはこの点でユニークではありません。 システムが主に別個の音声、またはむしろ音声コマンドを知覚することを強調する必要があります。 この場合、単語のセマンティックおよび音声の負荷はデバイスにとって重要ではないため、任意の言語のコマンドをアクションに「添付」できます。 音声制御メカニズムを実装するために、CMUSphinxライブラリと、ニューラルネットワークの分野での開発の一部を調べました。 現在、Juliusライブラリも検討しています。 現在、システムはKohonenニューラルネットワークを使用しています。 前処理中に、ハミング平滑化と離散フーリエ変換、および対数スペクトル圧縮が使用されます。

INCOSシステムとSmart Homeシステム間の相互作用の開発は進行中です。 この段階で、INCOSにはイーサネットケーブルを接続するためのコネクタがあります。 これらのデバイスはローカルネットワークを介して制御され、Webベースのインターフェイスを介してシステムを構成できます。

この段階で、非接触制御アルゴリズムをチェックできる機能的なプロトタイプがすでにあることがわかります。 残念ながら、上記の資料は、Boomstarterのプロジェクトで私たちが約束したものとはまだほど遠いものです 。 しかし、彼らはプロジェクトに取り組んでおり、新しいコンポーネントを使用し、意図した目標に向かって頑固に動いています。 Boomstarterに対する共同サポートが、INCOSのような興味深い有望なプロジェクトに活気を与えることを願っています。