Hector Levek wikiは、彼のコンピューターが愚かだと主張しています。 そしてあなたも。 SiriとGoogleの音声検索は、準備された提案を理解できます。 たとえば、「7時に近くで上映される映画は何ですか?」しかし、「ワニは100メートルのハードルを走ることができますか?」という質問はどうでしょうか。 しかし、大人は誰でもその答えを見つけることができます(いいえ。ワニはハードリングに参加できません)。 しかし、この質問をGoogleに入力しようとすると、フロリダゲーターズアスレチックスチームに関する膨大な情報が得られます。 Wolfram Alphaなどの他の検索エンジンも、この質問に対する答えを見つけることができません。 Jeopardy!Quizで優勝したコンピューターシステムであるWatsonのパフォーマンスは向上しそうにありません。

人工知能に関する国際共同 ウィキ 会議で最近発表された恐ろしい記事で、これらの問題を扱うトロント大学の科学者であるレベックは、AI開発に関係するすべての人を非難しました。 彼は、同僚が「人工知能」という用語の「知能」という言葉を忘れていたと主張しました。

Leveckは、有名なチューリングテストを批判することから始めました。 チューリングテストでは、一連の質問と回答を通じて、自動車と生きている対話者を区別しようとします。 コンピューターがチューリングテストに合格すれば、マシンにインテリジェンスがあると自信を持って結論付けることができると考えられています。 しかし、レベックは、チューリングテストは単純なゲームであるため、実用的ではないと主張しています。 毎年、いくつかのボットがこのテストに合格して、ローブナー賞のコンテストに合格しています。 しかし、勝者を真に知的と呼ぶことはできません。 彼らはあらゆる種類のトリックに頼り、本質的に欺deに従事します。 人がボットに「あなたの身長は?」と尋ねると、チューリングテストに合格するために、システムは空想を余儀なくされます。 実際には、勝者のボットはしばしば自慢し、知的と呼ばれるように誤解させようとします。 あるプログラムは妄想のふりをしました; 他の人は、単一行のフレーズで対談者をトローリングすることで自分自身をよく示しました。 プログラムがチューリングテストに合格しようとしてあらゆる種類のトリックや詐欺に頼ることは非常に象徴的です。 AIの真の目的は、1つのテストに合格するように調整されたプログラムを作成するのではなく、インテリジェンスを構築することです。

フローを正しい方向に向けようとすることで、LevekはAIの分野の研究者に、はるかに複雑な別のテストを提供します。 このテストは、彼がレオラ・モルゲンシュテルンとアーネスト・デイビスと行った仕事に基づいています。 彼らは一緒に、スタンフォード大学の人工知能の先駆者であるTerry Vinograd wikiにちなんで名付けられたGrape Schemesと呼ばれる一連の質問を開発しました。 70年代前半、Grapesは次の質問に答えることができるマシンを構築する質問をしました。

市当局は、暴力を恐れていたため、邪悪なデモ参加者に許可を与えることを拒否しました。 誰が暴力を恐れていますか?

a)都市管理者

b)邪悪なデモンストレーター

Levek、Davis、Morgensternは、合理的な人には簡単に見えるが、グーグルしかできないマシンには非常に難しいと思われる一連の同様のタスクを開発しました。 質問には、定義上、検索エンジンにほとんどリンクがない架空の人が含まれているため、Googleの助けを借りて解決するのは困難です。

ジョアンナは確かに彼女に提供してくれたスザンヌに感謝しました。 誰が助けた?

a)ジョアンナ

b)スザンナ

(タスクを複雑にするために、「レンダリング済み」を「受信済み」に置き換えることができます)

JoannaまたはSusannaという名前の人が誰かを助けているWebページを指で数えることができます。 したがって、そのような質問への答えは、人間の言語の複雑さおよび社会的相互作用の性質の非常に深い理解を必要とします。

他の質問は、ワニの質問を検索するのが難しいのと同じ理由でグーグルに難しいです。ワニは本当ですが、質問に現れる特定の事実はめったに議論されません。 例:

大きなボールが泡でできていたため、テーブルに穴を開けました。 ポリスチレン製のものは何ですか? (代替処方では、発泡体は鉄に置き換えられます)

a)大きなボール

b)テーブル

サムは羊飼いの絵をラムで描こうとしましたが、結局はゴルファーのようになりました。 誰がゴルファーのようになったのですか?

a)羊飼い

b)ラム

これらの例は、 アナフォラと呼ばれる言語現象(テキストで以前に出会った他の表現と同じエンティティを表す表現)と密接に関連していますが、常識を必要とするため困難です-まだ機械にはアクセスできません-また、Webページで頻繁に言及されないものが含まれているため、これらの事実は巨大なデータベースに分類されません。

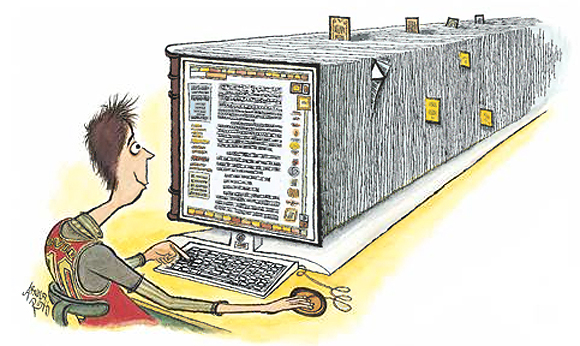

言い換えれば、これらは私がヘビーテール問題と呼んでいるものの例です。よくある質問はWebでよく答えられますが、まれな質問はそのビッグデータシステムでWeb全体を困惑させます。 ほとんどのAIプログラムは、探しているものがWebページに正確な引用として表示されない場合、トラブルに直面します。 これは、カナダのトロント市と米国の同名の市を混同するというワトソンの最も有名な間違いの理由の1つです。

同様の問題が2つの理由で画像検索で発生します。多くの希少な画像があり、多くの希少な画像キャプションがあります。 キャプションが「猫」である何百万もの写真があります。 Google検索では、「チョコレートタバコを持つスキューバダイバー」というクエリに関連するほとんど何も表示できません(葉巻、絵の美しさ、ビーチ、チョコレートケーキの写真)。 同時に、誰でも適切なスキューバダイバーの想像上の絵を簡単に作成できます。 または「右利きの人」というクエリを使用します。 Webには、右利きの人が右手で何かをしている(たとえば、野球を投げる)イメージがたくさんあります。 誰でも写真アーカイブからそのような写真をすばやく抽出できます。 しかし、「右利き」(「右利き」)という言葉で署名された写真はほとんどありません。 「右利き」という単語を検索すると、スポーツスター、キリン、ゴルフクラブ、キーホルダー、コーヒーマグの山の写真が大量に表示されます。 関連するものもありますが、ほとんどは関係ありません。

レベックは、レポートの終わりに向けて最も重要な発言を保存しました。 彼の懸念は、現代の人工知能がこの種の問題を解決できないということではなく、現代の人工知能がそれらについて完全に忘れていることです。 Levekの観点から見ると、AIの開発は「成功する銀の弾丸」のtrapに陥り、 エキスパートシステムであれBigDataであれ、常に次の大きなブレークスルーを探していますが、すべての普通の人が持っているほとんど目立たない深い知識は、綿密に分析されたことはありません。 これは巨大なタスクです-「道路を敷設する代わりに山を減らすようなものです」とレベックは書いています。 しかし、これはまさに研究者がしなければならないことです。

結論として、レベックは同僚に誤解を招くのをやめるよう促した。 彼は次のように述べています。「私たちの研究の範囲内にないものを正確に判断することで達成すべきことが多くあり、他のアプローチが必要になる可能性があることを認めます。 言い換えれば、人間の心の完全な複雑さを認識せずに人間の知性と競争しようとすることは、ワニに100メートルのハードルを走らせるように依頼するようなものです。

翻訳者から

私は、現代のSiriとGoogleに対するLevekの批判的な見解に興味がありました。 インテリジェント検索エンジンは、ユーザーが尋ねる質問をまねることを学びました。 しかし、彼らはいまだに映画を作り、本を書くAIから無限に遠く離れています。