彼は、深層学習と神経科学の交差点に関するスタンフォードシンポジウムに参加し、多くの喜びを受けました。

例えば、視覚野の機能をシミュレートするためのニューラルネットワークの使用に関するDan Yaminsのレポートなど、興味深いことについて話しています。

免責事項:この投稿は、 closedcircles.comのかなり編集されたチャットログに基づいて書かれているため、プレゼンテーションスタイルと明確な質問です。

ここに完全なレポートへのリンクがありますが、それはクールですが、おそらく投稿を読んでから見る方が良いでしょう。

ダンは計算神経科学に従事しています。 脳の研究に役立つ計算方法を試す そして、他の場所と同様に、ディープラーニングが発生します。

一般に、視覚皮質の高レベルのデバイスは少し理解しています

ある種の画像を見ると、目はニューロンの活性化を引き起こし、活性化は脳のさまざまな部分を通過します。

V1は一次視覚皮質とも呼ばれ、よく研究されています-画像上でいくつかのフィルターを実行し、異なる角度と単純な勾配で線上で活性化されるニューロンがあります。

(ところで、この領域でニューロンが活性化されるパターンは、多くの場合、CNNで最初に学習されたレベルに似ていますが、それ自体は非常にクールです)

この部分のモデリングにも成功しています-彼らは、ある種のモデルを考え出し、入力画像でニューロンがどのように活性化されるかを確認し、フィルタリングすると、新しいモデルでこれらのニューロンの活性化を完全に予測します。

V4およびIT(高レベルの処理)では、これは機能しません。

生体ニューロンに関するデータはどこから来ますか?

典型的な実験は次のようになります-サルを採取し、電極を脳のある部分に挿入し、それらが衝突したニューロンから信号を取得します。 猿はさまざまな写真を見せ、電極から信号を受け取ります。 これは数百のニューロンで行われます-脳の研究された部分のニューロンの総数は膨大であり、数百のみが測定されます。

V4およびITで生体ニューロンの活性化のためにモデルをフィルタリングしようとすると、過剰適合が発生します-データがほとんどなく、モデルは新しい画像について何も予測しません。

ダンの仲間は物事を異なるようにしようとします

モデルを取得して、ある種の認識問題のためにモデルを訓練し、その中の人工ニューロンがこれらの写真の何かを認識するようにします。

突然、彼らは生体ニューロンの活性化をより良く予測するでしょうか?

今、私たちは自分の手をしっかりと追っています。

モデル(CNNおよび通常のコンピュータービジョンの単純なモデル)をトレーニングして、合成画像内のオブジェクトを認識します。

写真は次のとおりです。

オブジェクトは背景と相関しません-湖の背景に飛行機があり、いくつかの野生の森の背景に頭があるかもしれません(私は理解しているように、事前の訓練を除外するために)。

合計で、写真には8つのカテゴリのオブジェクトがあります-頭、車、飛行機、その他。

そして今、異なる構造と深さのモデルは、オブジェクトのカテゴリを認識するように訓練されています。 他のモデルの中でも、Imagenetで事前にトレーニングされたCNNがあり、それらは合成データで使用したオブジェクトのカテゴリをトレーニングデータセットから削除します。

さらに、訓練されたCNNに基づいて、次のように生体ニューロンの活性化を「予測」します。

彼らはトレーニングセット(オブジェクトの特定のカテゴリ)を取得し、CNNと脳の一部のニューロンの特定のレベルを選択し、人工ニューロンに基づいて生体ニューロンの活性化を予測する線形分類器を構築します。

つまり、生物ニューロンの活性化を特定の層の人工ニューロンの活性化の線形結合として近似しようとします(結局、それらは完全に1対1に結合することはできず、それらの数はまったく異なります)。 そして、完全に異なるオブジェクトが存在するテストセットで予測力をどのように持っているかをチェックします。

説明したいと思います。

つまり、出力CNNとして-生物ニューロンの識別のようなものですか?

いや! CNN出力は、画像内のオブジェクトの分類子です。

CNNは画像を分類するためのトレーニングを行っていますが、生体ニューロンについては何も知りません。 グリッドのラベル付きデータは、生物学的ニューロンの知識がなくても、画像内のオブジェクトです。

そして、CNNに重みを記録し、人工ニューロン活性化の線形結合として生体ニューロンの適合性活性化を記録しました。

なぜ別のグリッドではなく、線形結合なのか?

人工的な生物学的予測は、システムが再トレーニングせず、CNNのニューロンの活性化から主要な信号を取得できるように、できるだけ単純にしたいです。

そして、新しいテスト画像で、生体ニューロンの活性化を予測できたかどうかを確認します。

だから、結果の写真!

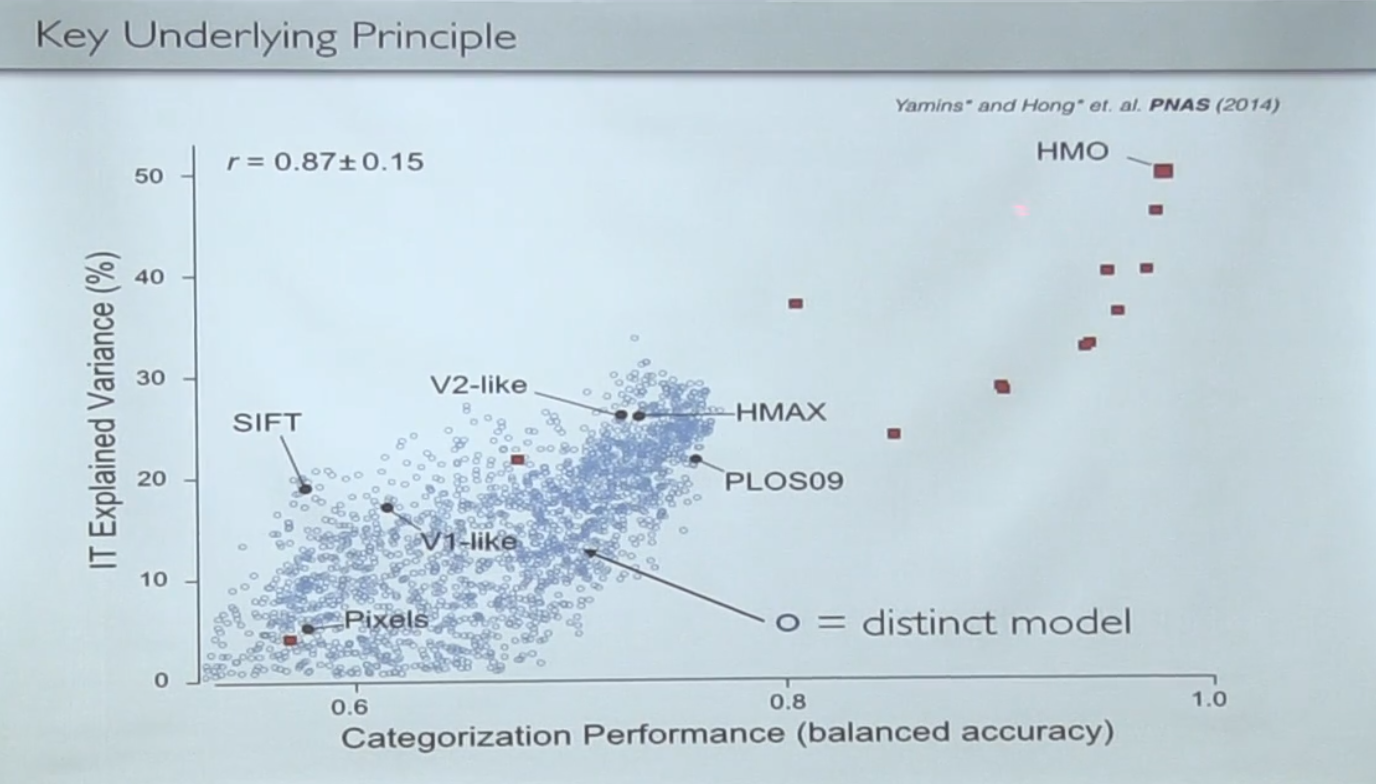

このグラフの各ポイントは、ある種の試行され、テストされたモデルです。

X軸-分類の精度、Y軸-生体ニューロンの予測の精度。

青い雲はまったく訓練されていないか、ゼロから訓練されたモデルであり、あまり深くないものがたくさんあり、右上の赤い点は事前訓練されたイメージネットモデルと完全な深層学習です。

モデルがどの程度適切に分類されているかは、生物学的活性化をどの程度適切に予測するかと強く相関していることがわかります。 つまり、モデルも機能する必要があるという制限を設定することにより、生体ニューロンの活性化のモデルを近似する方が良いことがわかります。

質問は取っておくかもしれませんが、それでもです。 しかし、脳内のニューロンを教師として使用して、何かを分類するモデルを教えることは可能ですか? タイプは写真を示した+脳からデータを取り、それをCNNに供給した?

これは私が前に話したのと同じことです-あなたはニューロンをほとんど知らないので、そのようなモデルは過剰適合し始め、予測力を持ちません。

つまり、ニューロンの活性化に関するトレーニングは一般化されておらず、オブジェクトの割り当てに関するトレーニングははるかに強力な制約です。

そして今、融合。

ニューラルネットワークのさまざまなレベルが、脳のさまざまな部分の活性化をどのように予測するかを確認できます。

最終レベルではIT(最終段階)を十分に予測できますが、V4(中間)は予測できません。 また、V4は中間ネットワーク層の最適な予測因子です。

したがって、ニューラルネットワークの特徴の階層表現は、最後だけでなく、処理の途中でも「隣接」します。これは、ここで起こっていることのある種の共通性があることを再び示唆しています。

つまり、彼らのニューラルネットワークは、脳内の生体ニューロンとほぼ同じに見えますか?

むしろ、認識プロセスがどの段階を経るかで似たようなものがあります。

「アーキテクチャ」が同じであると言うことは、もちろん、不可能です(もちろん、これを証明とみなすことなどできません)。

次の段階は-まあ、わかりました。動作中の脳のような未知の動作ボックスとして、他の脳をモデル化する機会を得たとしましょう。 この喜びは何ですか?

さらなる仕事は、脳の働きについて新しいことを理解するためにそれをどのように使用するかです。

1つの例について説明します。プレゼンテーション自体にはさらに2つあります。

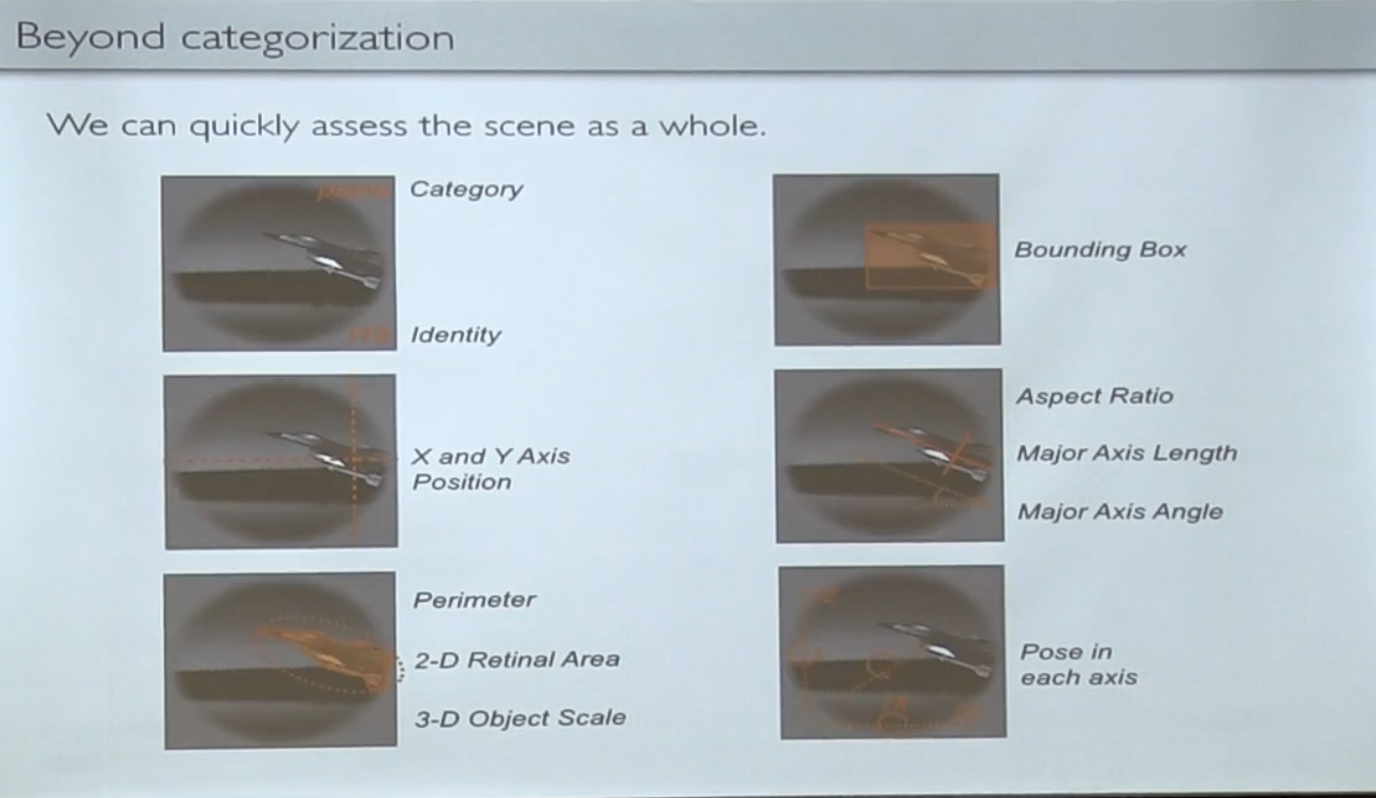

分類だけでなく、写真から他の信号(角度、サイズ、位置など)を引き出してみましょう。

これらはオブジェクトのクラスよりも「低レベル」の特徴であるように思われ、脳内の認識の低レベルで定義されていることが期待できます。これをモデルでテストしてみましょう。

イチジクがそこにあることがわかります!

そのような「低レベル」機能でさえ、低レベルの機能よりも高レベルのアクティベーションとの相関性が高くなります。 その後、彼らは生きた脳で追加の実験を行い、同じことを見ました-最初の層のパターンで見た線と角は、高レベルのオブジェクトの向きの「線」とは関係ありません。

オブジェクトの位置と相対位置に関する情報は非常に高いレベルに達します。

これは、最終段階(IT)がオブジェクト、それらの位置、相互関係などが存在する形成された高レベルモデルで動作するという既存の理論を確認し、さらに脳に必要なものに変換します。

(興味がある場合、他の例では、人生で顔を見たことのない仮想脳の訓練を通して顔を認識するために脳内に割り当てられた空間に関する仮説をテストし、音を認識することについて)

(アマチュアの質問を続ける)彼らは、CNNで同じ層数のモデルを使用しましたか? さて、つまり、レイヤーの数を減らすと、類似性の影響は消えますか?

いいえ、脳内の「層」の数は複雑です-エンドツーエンドの接続とフィードバックの両方があります。 CNNの層の数は、基本的に脳の数よりも少ないです。

そして、ITとV4についての会話はどうですか?

脳では、ITとV4は非常に多くのレベルですが、ニューラルネットワークにはほとんどレベルがありません。 ITとV4の生体ニューロンは、電極にぶつかるニューロンです。 それらの内部の「生物学的層」から判明したもの-それから判明した。

以下も興味深いものです。 Ramachandranによると、視覚野は単なるフィードフォワードネットワークではなく、すべてのレイヤーが双方向ですべてのレイヤーと通信します。 さまざまな種類の錯視によって視覚システムのバランスが崩れる例さえあります。

つまり、生物学的ニューロンの活性化が認識プロセス自体に何らかの形で関係していることを保証するものではなく、飛行機の外観のために猿の足がかゆみを始め、ニューロンがすでに足がかゆいという事実に反応しているという事実ではありませんか?

いいえ、これらは視覚野に関連していることが知られている領域のニューロンです(少なくとも脳に関するこの部分はわかっています-そこに傷を付けることはできません。スタックのさらに下にあります)。

要約すると、仕事の直接的な方向は、脳の仕事を研究するための新しいモデルの使用に関するものですが、何らかの方法でうまく機能する間接的なヒントがあり、一般的なメカニズムがあるかもしれません。

特異点に収束したいと考えています!