たとえば、この翻訳では、人工ニューラルネットワークとは何ですか? Rosenblattパーセプトロンについて次のことが書かれていることがわかります。

Rosenblattパーセプトンのデモンストレーションでは、特定の分野で知られている例を使用して、そのようなニューロンの単純なネットワークをトレーニングできることを示しました。 後に、ミンスキーとペーパーレットは、単純な教訓は非常に狭いクラスの線形分離可能な問題しか解決できないことを証明し、その後、ANNの学習活動は減少しました。 それにもかかわらず、例を使用して複雑なニューラルネットワークをトレーニングするタスクを促進できる学習エラーの後方伝播の方法は、これらの問題は分離できない可能性があることを示しました。

さらに、これはさまざまな記事、書籍、さらには教科書でも異なる方法で発生します。

しかし、これはおそらく最大のAI広告です。 しかし、科学ではこれは偽造と呼ばれます。

発明されたものは何ですか?

実際、すべての真面目な科学者は、ローゼンブラットパーセプトロンのそのような考えは真面目ではないことを知っています。 しかし、彼らはそれについてかなり穏やかに書くことを好みます。 しかし、歴史がかなりゆがんだ形で私たちに提示されるとき、そのような狭い科学分野では、これは良くありません。 意図的に改ざんされたとは言いたくありません。 そうではありませんが、これは若い人たちがオリジナルを読んでいないか、斜めに読んでいるという良い例です。そして、私は彼らが問題が何であるかを理解しているふりをします。 そして、この問題を解決します。 その後、彼らは医者になり、名声を得る。 そして、次世代は彼らを信じています。 真剣に何かをする場合は、常にオリジナルのクラシックを再確認してください。 記事の再投稿を信じないでください。

それでは、Rosenblattパーセプトロンを記述するオリジナルを開きましょう: Rosenblatt、F. Principles of Neurodynamics:Perceptrons and the theory of brain mechanism、1965 。 いわゆる 単層パーセプトロン-少なくとも1965年の間、自然界には存在しません。 彼はずっと後に発明されました。

そこには、Aエレメントの隠されたレイヤーを持つ基本パーセプトロンがすぐに表示されます。

これは、用語が変更されたという事実によって説明されることもあります。 悲しいかな、言葉を変えないでください-しかし、パーセプトロンには正しい層があり、常にそうでした。 さらに、Rosenblatt自身は、隠れ層のないパーセプトロンを考慮することは意味がないと書いています。 それは1965年の初歩であり、誰もが知っています。

彼らはミンスキーの権威をここにさらに加えたいと思っています。 しかし、彼はパーセプトロンとは何かを知っていました。 そして彼は、パーセプトロンが線形に分離不可能な問題を解決できないことを証明しませんでした。 彼は不変性の問題に関して完全に異なることを証明した。 そして、現在この問題を解決している既知のANNはありません。 (しかし、この記事はそれについてではありません。興味のある人がいれば、注文をして、それについて書きます。)

これに関して、RosenblattパーセプトロンとRumelhart多層パーセプトロン(MLP)の違いは次のとおりです。

1. Rumelhartパーセプトロンはエラー逆伝播アルゴリズムによってトレーニングされますが、入力層と隠れ層の間の重みと隠れ層と出力層の間の重みはトレーニングされます。

2. Rosenblatt Perceptronは、エラー修正アルゴリズムによってトレーニングされます。 このアルゴリズムでは、非表示層と出力層の間の重みのみがトレーニングされます。 入力と隠れ層の間のスケールに関しては、意識的に訓練されていません。 彼に教える意味はありません このレイヤーは、2番目とはまったく異なるタスクを実行します。 最初の層の重み係数、または刺激的結合と抑制的結合は、パーセプトロンでランダムに作成されます-ここでの性質をシミュレートします。 このレイヤーのタスクは、分離不可能な問題を分離可能な問題に正確に変換することです。 そして、最初の層の結合を通過する入力パルスは、A要素の空間にマッピングされます。 このランダム行列は、分離可能な問題への変換を提供します。

RosenblattパーセプトロンとMLPの両方の2番目の層は、変換後に得られた線形問題のみを分離しています。

これで、最初のレイヤーが必要な理由が明らかになることを願っています。それは、問題の分離不可能な(線形に分離不可能な)表現から分離可能な表現への変換を提供します。 これはMLPでも行われ、選択された逆伝播アルゴリズムはこれを変更しません。

しかし、Rosenblattパーセプトロンがランダム性を使用する場合、MLPはそのトレーニングを通じてこのランダム性を作成します。 それが全体の違いです。

他にも多くの違い、結果があります-しかし、この記事はまだ初心者向けではなく、少なくとも主題に少しだけ関わっている人向けです。 それから私は初心者のために、Rosenblattパーセプトロンはオリジナルから研究されるべきであることに注意したかっただけです。

しかし、何が忘れられましたか?

ローゼンブラットの姓は今ではまったくふさわしくありませんが、今では歴史的レビューでより頻繁に記憶されています。 Rosenblattは、1種類の人工ニューラルネットワークを開発したわけではないことに注意してください。 彼はあらゆる種類のニューラルネットワークの完全な分類を開発しました。 パーセプトロンという一般名の下に、現在のANNが含まれています。 Rosenblattには多層パーセプトロンもあります。これは、彼の用語では、2つの内側の層から始まり、再発パーセプトロン、および他の多くのサブタイプです。 さらに、現在開発中の特性とは対照的に、Rosenblattはより慎重に計算しました。 そのため、最初に新しく開発されたANNをRosenblattの対応するパーセプトロン分類と比較する必要があるだけです。そのような比較がない場合、新しいANNの有効性は完全に不明確です。 そして、ANNの多くの開発者はこれを行うことを気にしません。その結果、多くの人が呼び出され、呼び出される人はいません。

PSこれを言ったとき、私はしばしば懐疑に会いました。 しかし、あなたが突然私を信じないなら、記事Kussul E.、Baidyk T.、Kasatkina L.、Lukovich V.、Rosenblatt Perceptrons for Handwritten Digit Recognition、2001を読んでください。

結論として、私は、神話ではなくオリジナルでローゼンブラットパーセプトロンの研究に役立つリンクを提供します。 ここで、ローゼンブラットパーセプトロンの可能性を研究します。

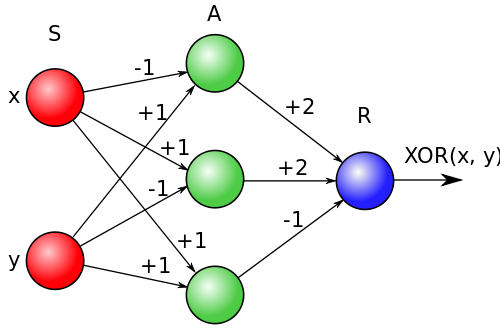

更新しました。 まだエラーに魅了されている人に捧げる-ローゼンブラットパーセプトロンによるXOR問題の解決

upd2。 みなさん、ありがとう、オリジナルを知らない人や読んでいない人のためのトレーニングは、ここでの私の仕事の一部ではありませんでした。 普通に話したい、個人で書いてください。 私はもはや挑発的なコメントには答えません。 基本を理解して読むことをお勧めします。