科学者はまだ、オートフォーカスが人や他の動物の目にどのように機能するかを正確に知りません。 非常に迅速かつ正確に動作することが知られています。 曖昧な画像を受け取ると、脳は対象物までの距離を即座に認識し、焦点距離(レンズの曲率)を変更して網膜上の鮮明な画像を取得します。

問題は、焦点機構が人間の視覚システムでどのように正確に機能するかです。 生物学者は現在、この質問の答えに近づいています。 テキサス大学オースティン校(米国)の知覚システムセンターの専門家は、最終的にはぼやけた画像の断片の焦点外れの程度を迅速かつ正確に計算することを学んだ自己学習統計アルゴリズムを開発しました。

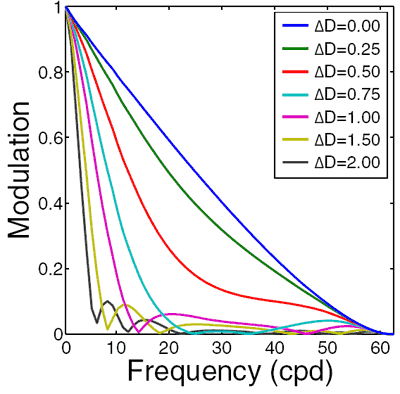

このアルゴリズムは、人間の視覚の生物学的システムのコンピューターモデルであり、128x128ピクセルのサイズの自然のシーンのデジタル写真の断片400枚に対して「トレーニング」されました。 まず、周波数コントラスト特性がどのように見えるか、つまり、さまざまな程度のデフォーカス(ジオプトリー、ΔD)の画像のMTF曲線に関するデータを収集しました。 画像のボケがこの特性に直接影響することは長い間知られています。

その後、0.25ディオプターのステップで精度最大化分析(AMA、精度最大化分析、 MatlabのAMAコード )の方法に基づくアルゴリズムが写真で実行されました。 ぼけた画像の周波数コントラスト特性のグラフを理想に最大限近づける最適なフィルターが得られました。

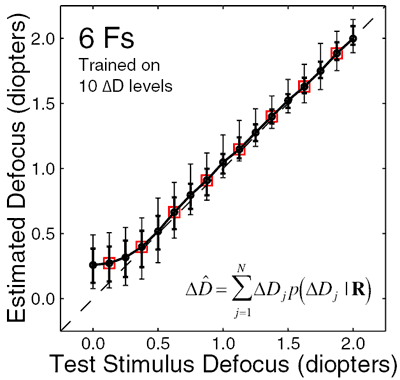

テストのために、科学者はフィルターが実行された新しいデータセット(別の400枚の画像)を取得しました。 同じオブジェクトに各フィルターを適用する場合、それらの作業の結果を比較し、どのフィルターが最も適しているか、つまり画像のぼかしの程度を理解できます。 このグラフは、ディオプターの焦点ぼけの度合いを決定するアルゴリズムの結果を、68%(太い垂直ストリップ)と90%(薄いストリップ)の確率で示しています。

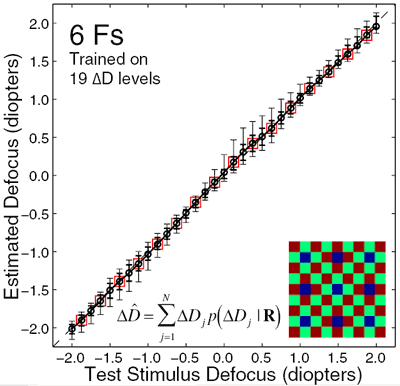

システムの精度を高めるために、科学者は人間の目の単色収差をモデルに追加することにしました。これは基本的に光学システムの回復不可能なエラーです。 各人の目は完全に機能するわけではありませんが、シャープネスと非点収差に一定の誤差があります。 これらのエラー(収差マップ)は、特別な眼科機器で測定できます。

科学者は、人間の目の収差マップと対応する周波数コントラスト特性を考慮して、フィルター操作アルゴリズムを変更しました。 奇妙なことに、ぼやけた画像の認識精度が大幅に向上しました。 人間の目による画像の鮮明さを決定する重要な役割は、非点収差によって演じられることが判明しました-軸の外側に位置し、狭い光線によって形成される点の画像は、異なる距離で互いに垂直に位置する2つの線分である人間の目の収差の一種です非収差焦点の面(ガウス面)から。

乱視を治療するとき、多くの患者が鮮明な画像を見る能力を一時的に失う理由が明らかになりました。

人間の目の色収差と回折を考慮した後、新しいフィルターははるかに高い精度で画像のぼけを認識することができました。

公開された作品は、デジタルカメラやビデオカメラだけでなく、シャープフィルター用の画像処理プログラムにも応用できる、根本的に新しいオートフォーカスシステムの基盤を形成できます。 ここでは、画像のいくつかの部分のコントラストを繰り返し測定することで、はるかに効率が悪いマルチポイントAFを置き換えることができます。

個々の自然画像での最適なデフォーカス推定。 ヨハネス・バージ、ウィルソン・S・ガイスラー。 国立科学アカデミー論文集、2011年10月4日、vol。 108番 40 、 doi:10.1073 / pnas。1108491108 、 PDF